生成AIが登場して以来、目覚ましく進化を遂げている。その存在は、私たちの想像を絶するスピードで社会に浸透してきたものの、果たしてこの新ツールは私たちの能力を高めているのだろうか。はたまた、奪っているのだろうか。

AIをめぐる懸念は「AI slop」という現象としても露呈し始めている。AI slopとは、低品質で、偽情報を含む可能性がある、アルゴリズムによって生成されたコンテンツがインターネット上に溢れる状況を指す言葉。有意義なコミュニケーションよりも、検索エンジンのアルゴリズム操作や、コンテンツのノルマ達成が優先されることで生じる。

こうした虚偽の情報や曖昧な情報が氾濫する中で、私たちは本当に価値のある情報を見極めることが求められる。今まで以上に、取り巻く環境に抗いながら深く思考しなくてはならないのだ。

この状況に一石を投じるキャンペーンを打ち出したのが、AI企業のAnthropic(アンソロピック)社。同社は2025年9月、「Keep thinking(思考し続けよ)」という新たなブランドメッセージを掲げ、同社初となる大規模な広告キャンペーンを開始した。その象徴的な取り組みが、ニューヨークに期間限定でオープンしたポップアップストア「Zero Slop Zone」だ。

この投稿をInstagramで見る

ここでは、無料のコーヒーや本、ペン、紙が提供される一方、パソコンやスマートフォンなどの持ち込みは禁止された。「thinking」という文字が刺繍された野球帽が配布され、開店日には長蛇の列ができたという。オランダを起点に広がるオフラインクラブと同様、デジタルから自主的に距離をとり、自分自身の意思で物事を考え、読書や会話の時間を大切にする機会を意図的に作る流れが続いている。

しかし今回、なぜ「AI企業が」オフラインの重要性を呼びかけるキャンペーンを仕掛けたのか。Anthropic社は、OpenAIの元メンバーによって設立されたAIスタートアップであり、人にとって安全で有益なAIの開発をミッションに掲げる。その思想は、同社が開発するAI「Claude(クロード)」の設計にも反映されている。

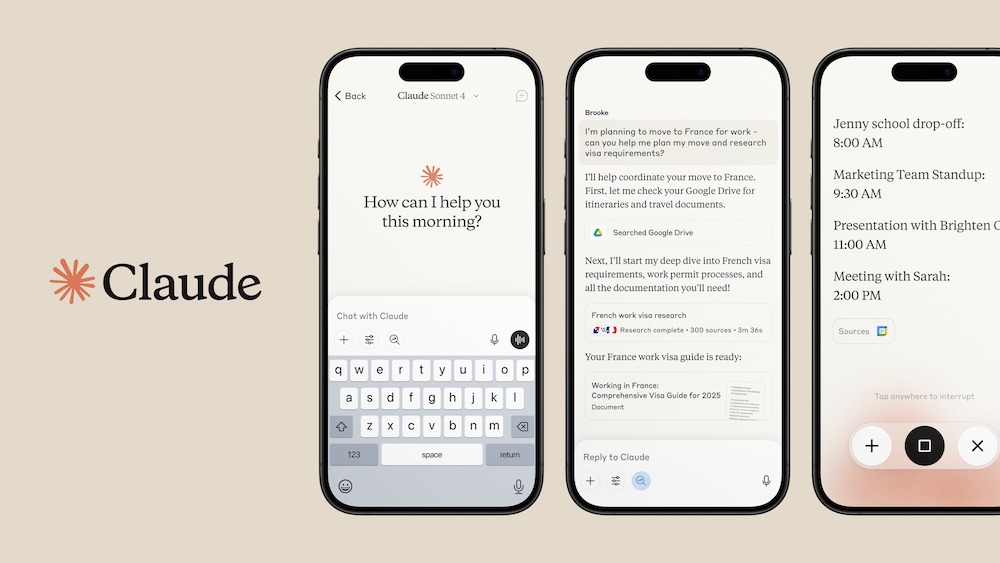

Image via Anthropic

同社が目指すのは、人間の思考を“代替”するAIではなく、人間の思考を“増幅”する「思考のパートナー」としてのAIだ。その思想を技術として裏付けるのが、同社が強化する透明性と安全性の取り組みである。

例えば、最新モデル・Claude 3.7 Sonnetに搭載された「Extended thinking mode(拡張思考モード)」という機能。ユーザーはこのモードをオンにすることで、より複雑な問いに対してClaudeに時間をかけて深く考えさせることができる。その思考プロセスは有害コンテンツを除きユーザーに可視化され、AIがどのように結論に至ったかを理解し検証することができる。

また、同社が公開している「Responsible Scaling Policy(責任あるスケーリング方針)」は、AIの能力が向上するにつれて、より厳格な安全対策を段階的に導入していく枠組みだ。これは、生物兵器研究などで用いられる「バイオセーフティーレベル」の考え方に着想を得ており、例えば、AIが化学兵器の開発に悪用されうるレベルの能力に達したと判断された場合、より高度な安全基準が適用される。こうしたリスク管理と併せて、言語モデルにおける差別的な判断を評価・軽減する研究開発にも注力している。

2025年10月にはアジア太平洋地域で初となるオフィスを東京に開設し、今後韓国・ソウルとインド・ベンガルールへの進出も公言するなど、アジア市場への展開も本格化しているAnthropic社。同社の「Keep thinking」というメッセージが単なるマーケティングスローガンに留まらないよう、ユーザーが「思考し続けるため」の具体的な仕組みを今後も導入し続けられるかが重要となるだろう。

今後のAI開発では、今回の事例のように、ただ速いことをアピールするのではなく、それぞれのAIがどのような思想や価値観に基づいて設計されるのかという「スタンス」を打ち出すマーケティングも増えていくだろう。そのときユーザー側も、その思想がAIの仕組みにどう実装され、それを主体的に使いこなせるかを丁寧に判断する役割を忘れてはならない。

【参照サイト】Claude

【参照サイト】Anthropic’s zero-slop pop-up invites New Yorkers to slow down and think|TrendWatching

【参照サイト】Claude’s Character|Anthropic

【参照サイト】Claude’s extended thinking|Anthropic

【参照サイト】Evaluating and Mitigating Discrimination in Language Model Decisions|Anthropic

【参照サイト】Announcing our updated Responsible Scaling Policy|Anthropic

【参照サイト】Anthropic officially opens Tokyo office, signs Memorandum of Cooperation with the Japan AI Safety Institute|Anthropic

【関連記事】AI音楽ユニットがSpotifyを“ハック”する?気候正義のため、収益をすべて寄付

【関連記事】AIは環境の“味方”か、それとも新たなリスクか?貢献と負荷のトレードオフを考える